本周,我们来看看一些新推出的人工智能工具:

- YouTube引入VEO模型

YouTube宣布引入Google Deepmind的VEO模型,用于生成Shorts短视频。VEO将集成到YouTube Shorts的Dream Screen中,用户可以使用Imagen 3模型生成图像,然后转换为6秒的高质量视频。为保证观众知情权,VEO生成的短视频将会添加水印以便于区分。

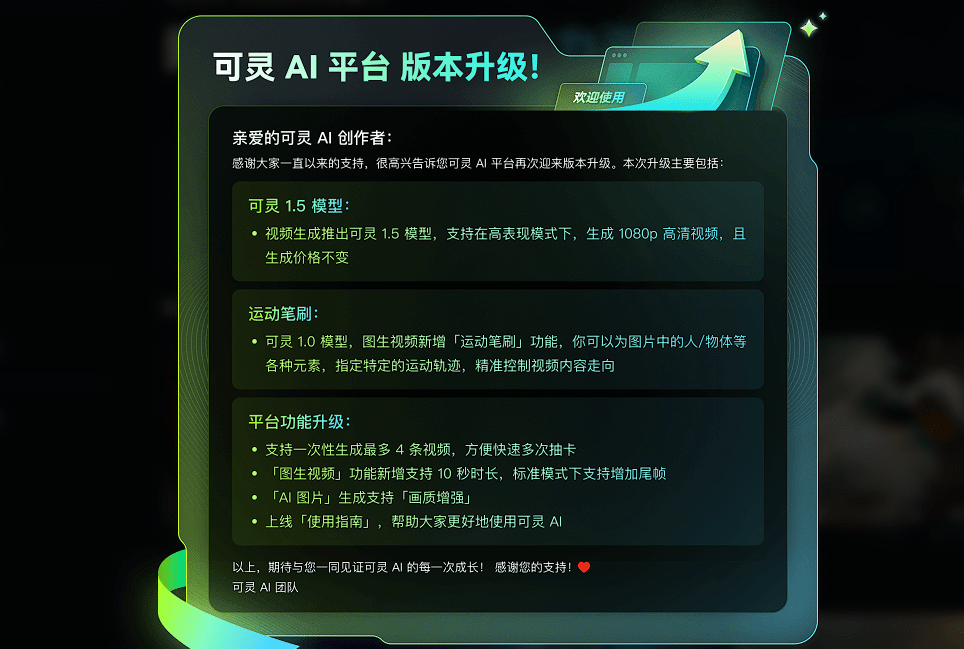

可灵发布了1.5版本,大幅提升了视频画质、清晰度和运动合理性。新版本支持1080p高清分辨率,新增了运动笔刷功能,允许用户为图像中的6个元素指定运动轨迹。1.5版本目前仅对付费用户开放。

阿里巴巴推出的视频生成模型通义万相开放测试。它支持中文提示词输入,可生成9:16、1:1以及4:3比例的视频,还能生成带背景音乐的短视频。笔者尝试后发现生成过程较慢,视频能力尚未达到主流模型水平。

Runway推出了video to video功能,并发布了操作指南。用户可以结合参考视频和文本提示词制作创意视频。Runway还加入了首尾帧功能,允许用户在视频开始和结尾处添加连贯图像。同时,Runway推出了API集成服务:Make anything, anywhere. With the Runway API. (runwayml.com),目前支持Gen-3 Alpha Turbo模型。

字节跳动推出了Seed Music音乐生成框架。它支持多模态数据输入生成音乐,可进行音乐转换、声乐和器乐生成、音乐编辑等。特别的是,它的Lyrics to Song功能可以基于文本提示和歌词生成对应风格的歌曲。

Luma推出Dream Machine API,帮助开发者将视频生成能力集成到产品中。开发者可以使用Luma最新的模型生成创意视频,如集成关键帧功能等。

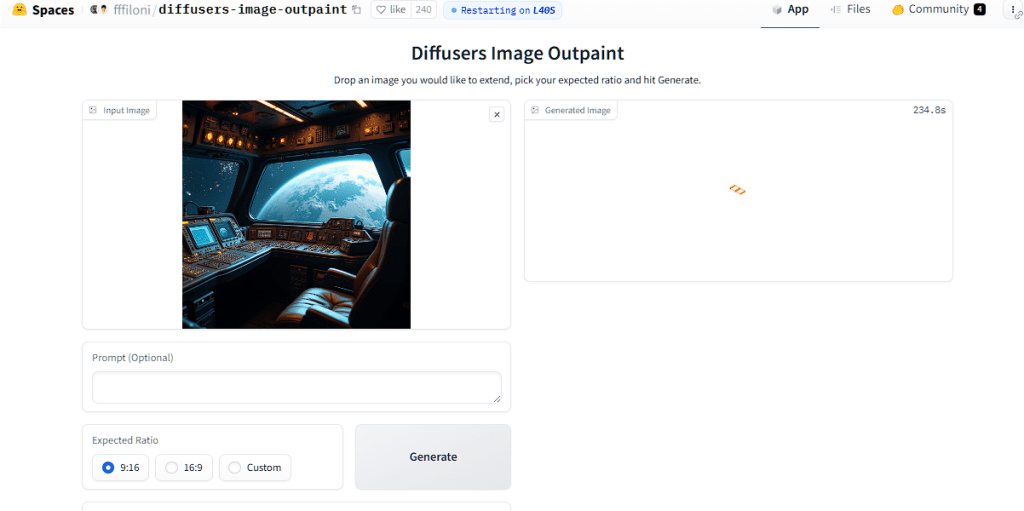

这是一个免费的图像延伸工具,支持生成16:9和9:16比例的图像。基于RealVisXL V5.0 Lightning模型,能在2秒内完成图像扩展。

这个项目可以从单张图片实时生成可交互的3D场景。用户可以通过提示词实时扩展图像,生成可交互的3D全景图,并能控制移动和镜头方向。

Tripo发布了2.0版本,可基于单张参考图实现高质量的图像转3D操作。新版本能在几秒内生成带纹理的3D网格模型,支持二次编辑和调整,还加入了骨骼和动作绑定功能。

今天的AI资讯就到这儿了,感兴趣的同学可以点击链接尝试这些工具,我们下周再见。