2024年最后一期,今天总结一下近一周的AI新闻:

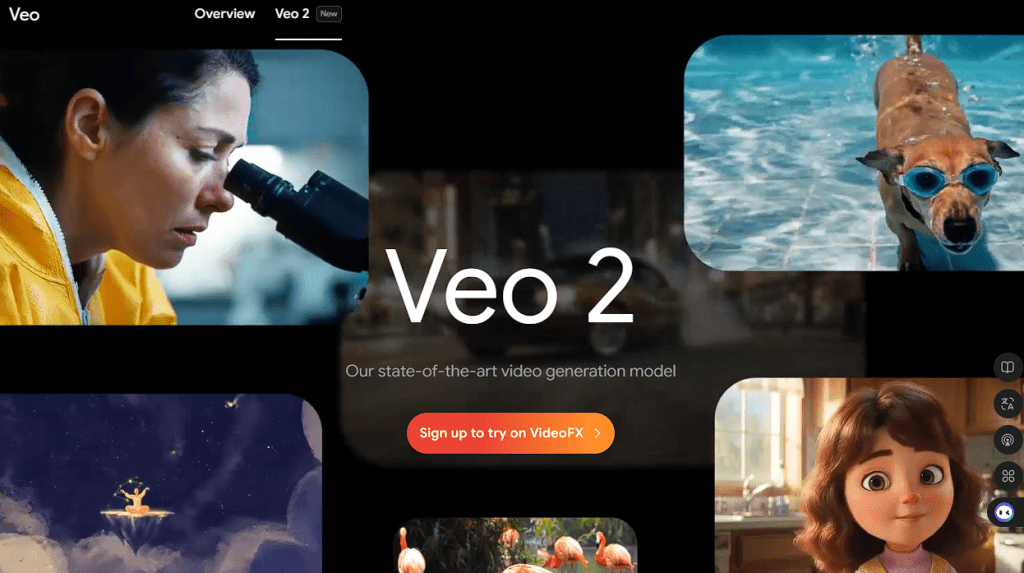

本周,参与前期测试的用户发布了大量基于VEO2模型生成的视频,演示画面展现了其在真实物理运动模拟方面的高超水平。VEO2的文本转视频功能在东方人物面容刻画和特效生成领域表现尤为出色,超越了市面上的主流模型。测试艺术家们纷纷表示,VEO2不仅能轻松融合多种复杂要素生成流畅的视频效果,还完全没有合成痕迹。如果你对这一强大的模型感兴趣,可以申请加入等待列表,尽早体验这项前沿技术。

Google本周发布了全新的whisk工具,支持通过组合多张照片风格生成创意图像,而无需输入提示词。用户可上传两张图像,将第一张图像的风格迁移到第二张上,并通过简单编辑进一步增强效果。完成风格迁移后,用户还可添加第三要素,通过文本提示将生成背景融合到图像中。这一工具的操作极为简便,只需两个步骤即可轻松生成高质量图像。目前,Whisk仅在美国地区开放,切换节点即可免费使用。

ElevenLabs本周发布了Flash系列模型,进一步推进了语音生成的效率和多样性。Flash VR模型支持英文语音生成,生成时间仅需75毫秒,而Flash V2.5扩展到32种语言。尽管其生成语音的情感深度稍逊于Turbo模型,但极低的延迟使其在行业中保持领先地位。用户可登录ElevenLabs官网,选择“text-to-speech”选项并切换到Flash模型,便可体验这款高效工具。

Domo Video-to-Video 5.0:动漫到真人的转换利器

Domo本周推出了Video-to-Video 5.0测试版,为视频生成领域带来更多可能性。该模型支持将动漫视频转换为真实人像风格,并通过提示词实现视频主体外观的替换功能,类似于Runway的Act One工具。用户可通过这项新功能尝试创作更具个性化和视觉冲击力的视频内容,为视频制作提供更多灵感和创意。

字节本周宣布推出豆包视觉理解模型,其在内容识别、视觉描述和推理能力方面取得了重大进步。用户只需拍照即可识别图像中的数学公式、图表,并获得相关推理解答。同时,该模型还支持代码理解、编程和数据分析,成为一个多功能AI工具。更令人惊喜的是,豆包视觉模型的使用成本极低,1元即可处理约300张图像,为个人与企业用户提供了性价比极高的解决方案。

Pixverse 3.5在镜头跟踪和运动模拟方面表现尤为突出,支持文本与图像转视频两种模式,生成效果更上一层楼。而可灵1.6则在提示响应、视觉美感和物理动作表现上大幅提升,其性能比1.5版本提高了两倍。新版本支持标准与专业模式,并能生成更流畅的画面及多风格内容。使用高清图像作为参考,用户可以在图像转视频模式中获得更好的效果,尽管免费用户需排队使用,但其生成效果依旧令人期待。

Genesis Project:探索4D动态世界的生成式物理引擎

Genesis Project是本周发布的一款生成式物理引擎,支持以自然语言描述生成4D动态世界。它能模拟各种真实的物理现象与材料运动,并可创建3D交互式场景,用于机器人技能训练和流畅角色运动生成。Genesis基于大语言模型的智能代理核心,能够结合多种工具创建符合真实物理规律的虚拟世界,为科学研究和技术应用开辟了新的可能性。

ODYSSEY与Pixar创始人联合推出了Explorer模型,可将任何图像转换为可编辑的3D世界。该模型生成的内容不仅具备电影级的细节和保真度,还能实现持续运动和视角操控,适用于游戏场景、广告视频和影视制作。此外,生成的高斯建设纹理可以直接加载到虚幻引擎中进行编辑,为创作者提供更多灵活性。目前,Explorer模型已与伦敦的Garden Studios合作,将其生成内容用于电视广告制作,进一步验证了其商业潜力。