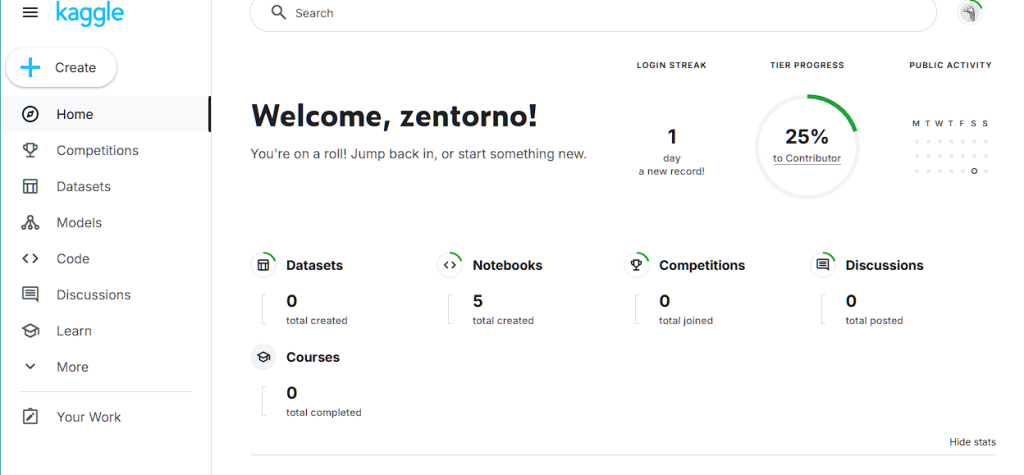

在 Kaggle 平台上可以训练建筑图纸分类或生成模型,首先介绍一下kaggle:

Kaggle 是一个全球知名的数据科学和机器学习平台,专为数据科学家、机器学习工程师和人工智能爱好者设计。Kaggle 由 Google 旗下的 Alphabet 公司运营,提供了丰富的资源和工具,帮助用户快速上手数据分析和模型开发。

Kaggle 简介

Kaggle 是一个全球知名的数据科学和机器学习平台,专为数据科学家、机器学习工程师和人工智能爱好者设计。Kaggle 由 Google 旗下的 Alphabet 公司运营,提供了丰富的资源和工具,帮助用户快速上手数据分析和模型开发。

Kaggle 的主要功能

- 数据集平台

- 提供海量的免费数据集,涵盖金融、医疗、自然语言处理、图像处理等领域。

- 用户可上传和共享自己的数据集,建立开放的数据生态系统。

- 竞赛(Competitions)

- 平台组织全球性的机器学习竞赛,吸引了来自各个行业的顶尖团队和个人。

- 参赛者通过构建模型解决实际问题(如预测、分类等),可获得丰厚奖金和业内认可。

- Kaggle Notebook

- 提供云端编程环境,支持 Python 和 R 编程语言。

- 集成了 GPU 和 TPU 加速,无需配置本地环境即可快速实验和开发模型。

- 讨论社区(Discussion)

- 用户可以就技术问题、竞赛策略和研究进展展开讨论。

- 初学者和专家可通过互动相互学习,共同成长。

- 代码共享与 Kernels

- 用户可分享自己的代码和分析流程,形成开放共享的学习资源。

- Kernels(现称为 Notebooks)支持代码可视化、运行和分享。

- 学习资源

- 提供从基础到高级的学习课程,包括数据可视化、机器学习、深度学习等内容。

- 用户可以通过参与微型课程(Micro-Courses)快速上手新技术。

从数据准备到模型训练和评估,具体流程如下:

1. 项目准备

目标定义

明确任务是:

- 分类:对建筑图纸进行分类(如平面图、立面图、剖面图等)。

- 生成:通过输入(如文本或草图)生成建筑图纸或设计。

工具与框架

Kaggle 提供以下资源:

- 数据集:搜索或上传相关数据集。

- 环境:使用 Kaggle Notebook(支持 TensorFlow、PyTorch、Scikit-learn 等)。

- GPU支持:启用 GPU 提升训练速度。

数据获取

- 公共数据集:在 Kaggle 数据库中搜索关键词(如 “architectural drawings”)。

- 自定义数据:上传自己的建筑图纸数据集,需确保数据格式统一。

数据清洗与标注

对数据进行预处理:

- 分类任务:

- 图纸分类标签:

{"plan": 0, "elevation": 1, "section": 2}。 - 转换为 CSV 文件:包含文件路径及其对应的标签。

- 图像尺寸归一化:如调整到

256x256。

- 图纸分类标签:

- 生成任务:

- 结构化输入与输出数据:如手绘草图与最终建筑图纸的成对数据。

- 数据增强:增加翻转、缩放等操作,提升模型泛化能力。

3. 模型设计

分类模型

可使用卷积神经网络(CNN)实现图纸分类任务:

- 常用模型架构:ResNet、EfficientNet、InceptionV3 等。

- 步骤:

- 初始化预训练模型(如 ResNet50)。

- 修改最后的全连接层以适应分类任务。

- 添加 Dropout 层避免过拟合。

- 使用交叉熵损失函数和 Adam 优化器。

生成模型

生成建筑图纸常用生成对抗网络(GAN)或扩散模型:

- 工具选择:

- Pix2Pix:用于从草图生成建筑图。

- ControlNet:结合输入控制条件生成图纸。

- 步骤:

- 构建生成器和判别器网络。

- 使用 L1 损失和对抗性损失共同优化。

- 对输入数据(如手绘草图)进行条件编码,生成目标设计。

4. 模型训练

分类模型

python复制代码import tensorflow as tf

from tensorflow.keras.applications import ResNet50

from tensorflow.keras.layers import Dense, Dropout, Flatten

from tensorflow.keras.models import Sequential

# 加载预训练模型

base_model = ResNet50(weights="imagenet", include_top=False, input_shape=(256, 256, 3))

# 自定义顶层

model = Sequential([

base_model,

Flatten(),

Dense(256, activation="relu"),

Dropout(0.5),

Dense(3, activation="softmax") # 三分类

])

# 编译模型

model.compile(optimizer="adam", loss="sparse_categorical_crossentropy", metrics=["accuracy"])

# 训练模型

model.fit(train_data, train_labels, validation_data=(val_data, val_labels), epochs=10)

生成模型

使用 Pix2Pix 或 ControlNet 的 PyTorch 实现:

import torch

import torchvision.transforms as T

from torchvision.models import pix2pix

# 初始化生成器和判别器

generator = pix2pix.get_model("resnet", pretrained=True)

discriminator = pix2pix.get_discriminator()

# 定义损失函数和优化器

criterion = torch.nn.MSELoss()

optimizer_g = torch.optim.Adam(generator.parameters(), lr=0.0002)

optimizer_d = torch.optim.Adam(discriminator.parameters(), lr=0.0002)

# 训练循环

for epoch in range(epochs):

for i, (inputs, targets) in enumerate(train_loader):

# 生成器和判别器的前向传播和优化

outputs = generator(inputs)

loss_g = criterion(outputs, targets)

loss_d = criterion(discriminator(outputs), torch.ones_like(outputs))

optimizer_g.zero_grad()

loss_g.backward()

optimizer_g.step()

optimizer_d.zero_grad()

loss_d.backward()

optimizer_d.step()